Ils ont dépassé le point de bascule… avec 94 qubits logiques

Dans le monde quantique, il existe un moment très particulier que les physiciens anglosaxons appellent le break-even ou (point de basule ou point mort en français).

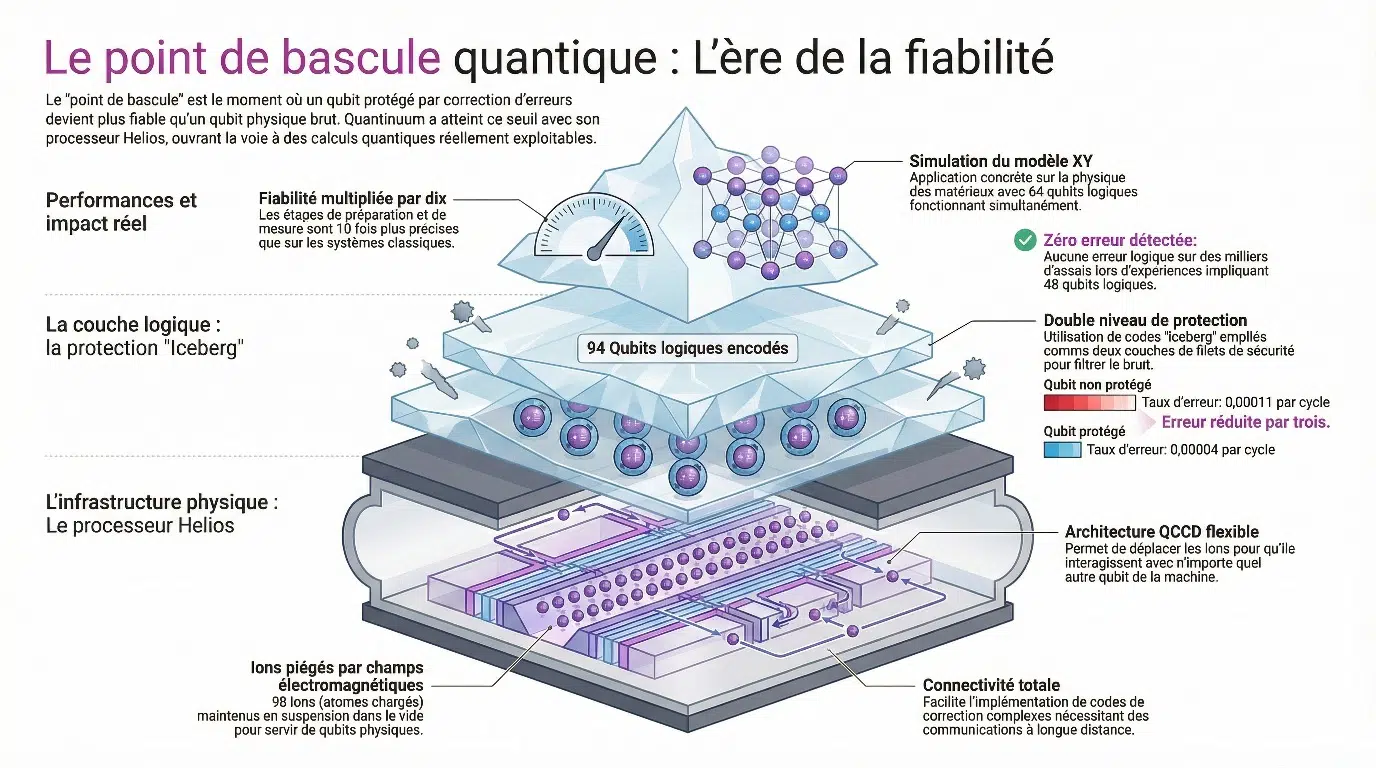

C’est l’instant où un qubit protégé par correction d’erreurs devient réellement plus fiable qu’un qubit laissé seul face au bruit.

Pendant longtemps, ce seuil a ressemblé à une promesse théorique…

Et pourtant cette semaine, des chercheurs de la société britannique Quantinuum ont déposé une étude qui revient sur le franchissement de cette étape.

Sur leur processeur Helios, ils ont réalisé des calculs avec jusqu’à 94 qubits logiques encodés, en obtenant systématiquement de meilleures fidélités que les opérations physiques non protégées.

Pour vous, tout ça c’est du chinois ? Pas de panique on va vous expliquer ce que ça veut dire pour l’avenir de l’informatique quantique.

Lire aussi :

- Personne ne le sait mais la France a le plus puissant ordinateur quantique phonique du monde : Bélénos

- La production d’hydrogène vient de connaître son « bond quantique » avec cette découverte américaine qui pourrait donner une impulsion décisive à la photocatalyse

Quantinuum arrive à atteindre le point de bascule quantique pour la première fois dans l’Histoire

Pourquoi corriger les erreurs en quantique est si difficile ?

Un qubit physique est fragile.

Il interagit avec son environnement et peut accumuler des erreurs.

Corriger ces erreurs suppose d’encoder l’information d’un qubit logique dans plusieurs qubits physiques.

Le problème, c’est que chaque opération supplémentaire peut elle-même introduire du bruit.

On peut alors se retrouver dans une situation absurde où la correction crée plus d’erreurs qu’elle n’en supprime !

Le fameux point de bascule, c’est le moment où protéger un qubit avec un système de correction d’erreurs devient réellement utile.

Avant cela, on dépense beaucoup d’énergie à corriger… sans forcément faire mieux qu’un qubit laissé tel quel.

Dans cette étude, les chercheurs montrent que leur méthode réduit le taux d’erreur à environ 0,00004 par cycle, alors qu’un qubit non protégé présente une erreur d’environ 0,00011 sur la même durée.

Autrement dit, le qubit « protégé » se trompe presque trois fois moins souvent que le qubit brut.

À partir de là, la protection n’est plus un pari théorique. Elle améliore réellement la fiabilité du calcul.

Helios, un processeur taillé pour la correction d’erreurs

Les tests ont été réalisés sur Helios, un ordinateur quantique qui utilise 98 ions piégés comme qubits.

Concrètement, chaque qubit est un atome chargé maintenu en suspension par des champs électromagnétiques, un peu comme une bille invisible parfaitement immobilisée dans le vide.

L’architecture dite QCCD permet de déplacer ces ions à l’intérieur de la machine et de les faire interagir presque avec n’importe quel autre.

C’est un avantage important, car certains systèmes quantiques ne permettent que des interactions entre voisins immédiats.

Or, certains codes de correction d’erreurs ont besoin que des qubits éloignés puissent communiquer entre eux.

Sur d’autres plateformes, cela complique énormément les choses.

Sur Helios, cette flexibilité est naturelle, ce qui facilite l’implémentation des codes utilisés.

Les chercheurs ont choisi des codes appelés « iceberg », qui permettent de protéger beaucoup de qubits logiques sans exploser le nombre de qubits physiques nécessaires.

En empilant deux niveaux de protection, un peu comme deux couches de filet de sécurité, ils parviennent à corriger les erreurs tout en restant efficaces.

Doté des qubits logiques à la plus haute fidélité, d’une nouvelle pile logicielle de génération suivante intégrant un langage de programmation moderne de haut niveau appelé Guppy, ainsi que de GPU NVIDIA directement intégrés au système de contrôle, Helios est conçu pour accélérer l’adoption de l’informatique quantique par les entreprises.

La plateforme Helios est désormais accessible aux clients via le service cloud de Quantinuum ainsi qu’en déploiement sur site.

Des résultats qui ne se limitent pas à un seul test

Les chercheurs n’ont pas testé leur système sur un seul exercice isolé.

Ils ont vérifié les éléments de base de tout calcul quantique : préparer un état, le manipuler avec des portes logiques, puis le mesurer.

Pour la préparation et la mesure, les versions protégées sont au moins dix fois plus fiables que les versions non protégées.

Même chose pour les portes logiques, y compris celles qui font interagir deux qubits.

Une porte protégée présente une erreur d’environ 0,0001, alors qu’une porte physique classique tourne plutôt autour de 0,0008.

Cela peut sembler minuscule, mais quand on enchaîne des centaines ou des milliers d’opérations, la différence devient énorme.

Encore plus marquant : lors d’expériences impliquant 48 qubits logiques protégés, aucune erreur logique n’a été détectée sur des milliers d’essais.

À ce stade, on ne parle plus d’un simple effet statistique. On commence à entrevoir une fiabilité utilisable pour de vrais calculs !

Une application concrète : simuler un modèle quantique

Pour prouver que leur travail ne se limite pas à des tests théoriques, les chercheurs ont appliqué leur méthode à un vrai problème de physique.

Ils ont simulé un modèle appelé XY tridimensionnel, utilisé pour étudier le comportement collectif de particules dans certains matériaux.

Cette fois, ils ont travaillé avec 64 qubits logiques protégés.

Résultat : l’erreur moyenne par opération a diminué d’environ 30 % par rapport à la même simulation réalisée sans protection.

Bien sûr, protéger les qubits demande un peu plus d’exécutions pour obtenir un résultat propre.

Ce surcoût est resté raisonnable grâce à des techniques de tri des données qui éliminent les résultats manifestement erronés.

En clair, la correction d’erreurs ne sert pas seulement à briller sur des graphiques.

Elle améliore déjà la précision de calculs utiles en physique !

Une étape vers le calcul quantique tolérant aux fautes

Ce travail ne signifie pas que le calcul quantique universel, entièrement tolérant aux fautes, est à portée immédiate.

Il démontre cependant que l’encodage logique peut améliorer les performances dès aujourd’hui, sur des machines existantes.

L’approche repose aussi sur un co-design étroit entre matériel et protocoles.

Les routines de correction ont été optimisées pour exploiter au maximum les capacités du processeur Helios, notamment la connectivité et le contrôle en temps réel.

Cette synergie entre architecture physique et théorie des codes constitue probablement l’un des leviers majeurs pour les prochaines années !

Qui est Quantinuum, à l’origine de cette découverte ?

Basé à Broomfield, Colorado (Etats-Unis) et à Cambridge au Royaume-Uni, Quantinuum est née de la fusion entre Honeywell Quantum Solutions et Cambridge Quantum, et elle s’est rapidement imposée comme l’un des acteurs majeurs du secteur des ordinateurs quantiques à ions piégés.

Elle a déjà établi plusieurs jalons remarqués, notamment en démontrant des circuits aléatoires dépassant les capacités de simulation classique sur certaines configurations spécifiques, en publiant des résultats de fidélité parmi les plus élevés du marché pour des portes à deux qubits, et en développant des protocoles avancés de correction d’erreurs et de compilation optimisée. Quantinuum s’est également distinguée par des collaborations industrielles en chimie quantique, en cybersécurité post-quantique et en génération certifiée de nombres aléatoires, montrant qu’elle ne vise pas uniquement la performance académique, mais aussi des applications concrètes.

Sources :

Dasu, S., DeCross, M., Guo, A. Y., Lavasani, A., Behrends, J., Benhemou, A., … & Amaro, D. (2026). Computing with many encoded logical qubits beyond break-even. arXiv. https://doi.org/10.48550/arXiv.2602.22211 [Preprint]